Sicherheit? Egal, Einsatz generativer KI-Tools wird priorisiert

Einsatz generativer KI-Tools wird priorisiert: Eine neue Studie legt nahe, dass Unternehmen trotz erheblicher Sicherheitsbedenken den Druck verspüren, generative KI-Tools (GenAI) schnell einzusetzen.

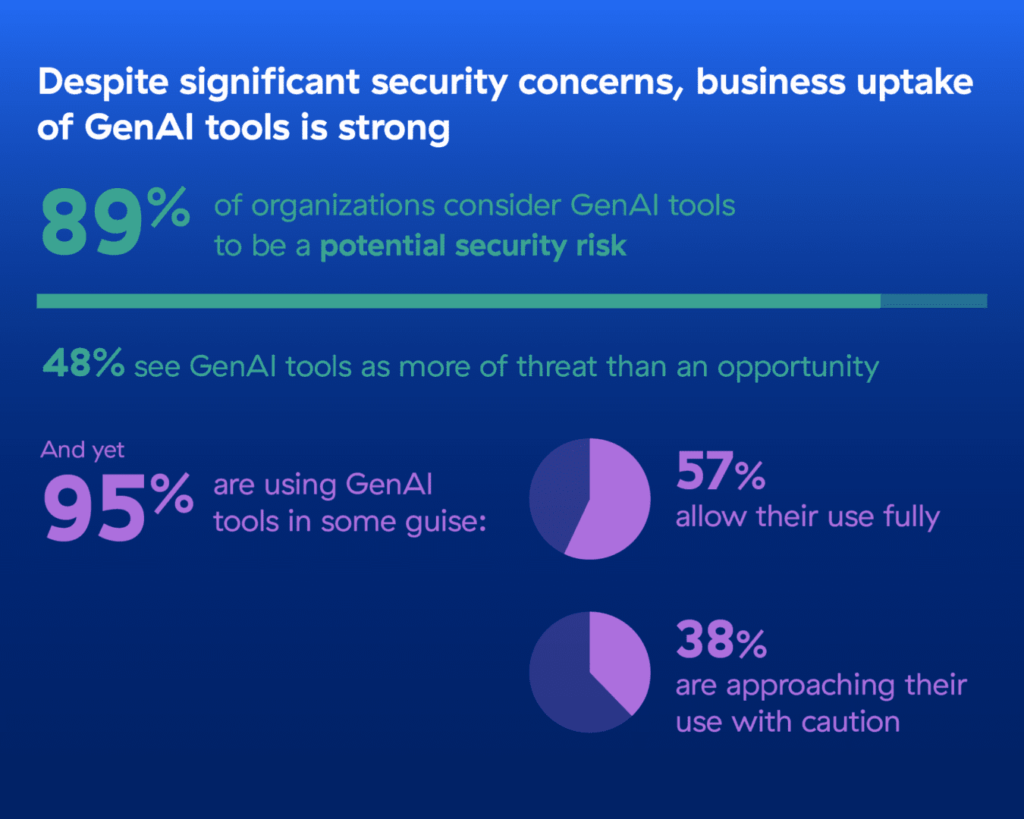

Laut der Umfrage „All eyes on securing GenAI“ unter mehr als 900 globalen IT-Entscheidern sehen zwar 89 Prozent der Unternehmen generative KI-Tools wie ChatGPT als potenzielles Sicherheitsrisiko an (99 Prozent in Deutschland), doch 95 Prozent (88 Prozent in Deutschland) nutzen sie bereits in irgendeiner Form für ihr Unternehmen.

Einsatz generativer KI-Tools wird priorisiert

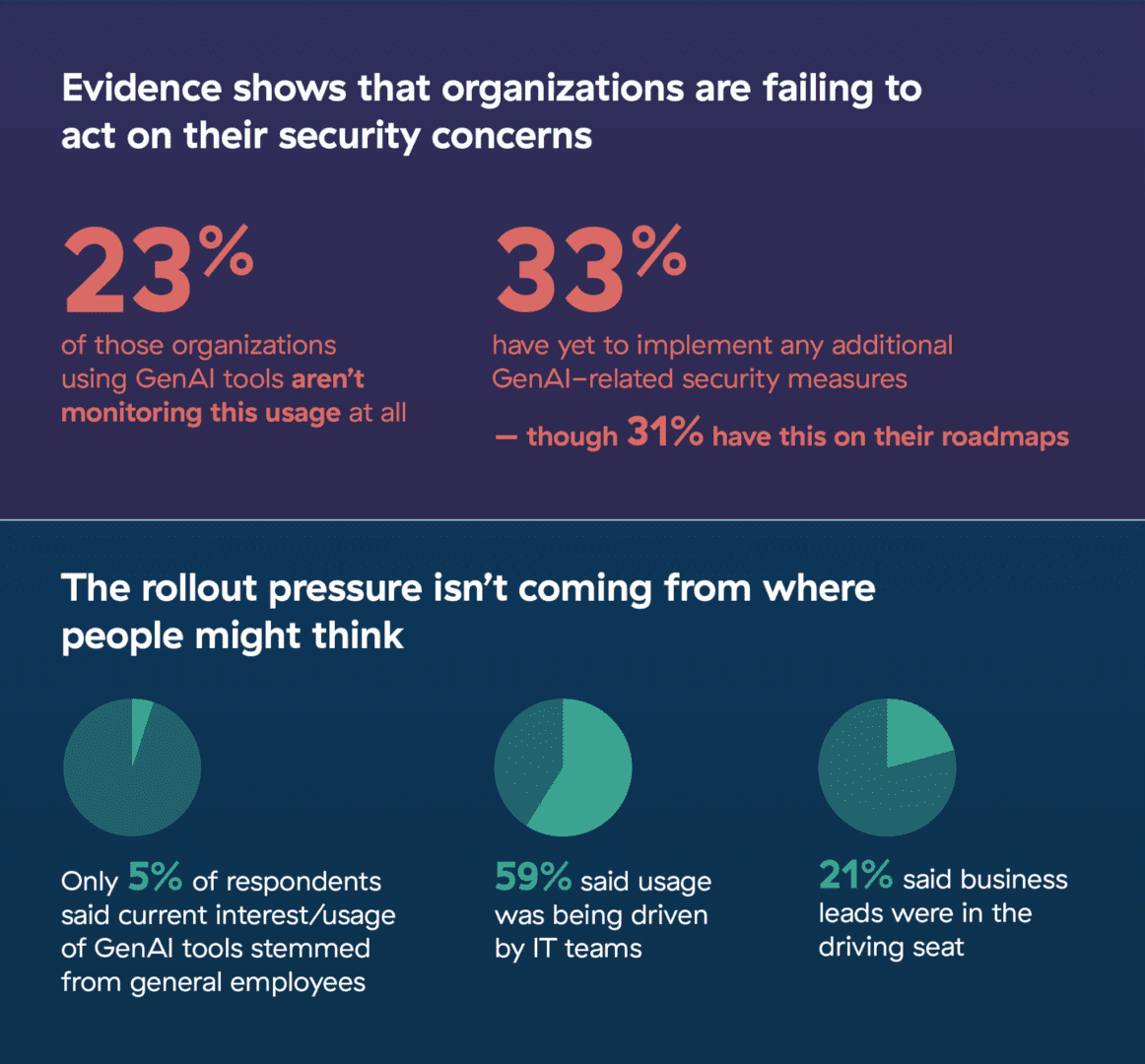

Sicherheit? Noch beunruhigender ist, dass 23 Prozent (25 Prozent in Deutschland) der befragten IT-Entscheider die Nutzung dieser Tools überhaupt nicht überwachen und 33 Prozent (40 Prozent in Deutschland) noch keine zusätzlichen GenAI-bezogenen Sicherheitsmaßnahmen implementiert haben – obwohl viele dies auf ihrer Agenda haben. Besonders ausgeprägt scheint die Situation bei kleineren Unternehmen (500 bis 999 Mitarbeiter) zu sein, wo die gleiche Anzahl von Organisationen weltweit GenAI-Tools einsetzt (95 Prozent), aber sogar 94 Prozent das Risiko erkennen, das damit verbunden ist.

„GenAI-Tools, wie ChatGPT und andere, versprechen für Unternehmen immense Vorteile in Bezug auf Geschwindigkeit, Innovation und Effizienz“, betont Sanjay Kalra, Vice President Product Management bei Zscaler. „Angesichts der derzeitigen Unklarheit in Bezug auf ihre Sicherheitsmaßnahmen sehen jedoch nur 39 Prozent der Unternehmen ihre Einführung eher als Chance denn als Bedrohung. Dies gefährdet nicht nur die Integrität ihrer Geschäfts- und Kundendaten, sondern verschenkt auch ein enormes Potenzial.“

Sicherheit? IT-Teams wollen generative KI

Der Druck, solche Tools schnell einzusetzen, kommt jedoch nicht von den vermuteten Abteilungen in Unternehmen. Trotz des allgemeinen Interesses für diese Tools scheinen nicht die Mitarbeitenden die treibende Kraft hinter dem aktuellen Interesse und der Nutzung zu sein – nur fünf Prozent der Befragten gaben an, dass die Nutzung von dieser Nutzergruppe ausgeht. Stattdessen gaben 59 Prozent (60 Prozent in Deutschland) an, dass der Einsatz direkt von den IT-Teams vorangetrieben wird. Sicherheit? Dieses Ergebnis deutet darauf hin, dass die IT-Abteilung die Kontrolle über die sichere Anwendung dieser Tools zurückgewinnen kann.

„Die Tatsache, dass IT-Teams das Ruder in der Hand haben, sollte den Geschäftsführern ein gutes Gefühl vermitteln“, führt Kalra aus. „Es verdeutlicht, dass das IT-Team die Möglichkeiten hätte, das Tempo der GenAI-Einführung strategisch zu drosseln und die Sicherheitsmaßnahmen in den Griff zu bekommen, bevor die Verbreitung im Unternehmen noch weiter voranschreitet. Es ist jedoch wichtig zu erkennen, dass das Zeitfenster für eine sichere Einführung und Verwaltung immer kleiner wird.“ Da 51 Prozent (40 Prozent in Deutschland) der Befragten bis zum Ende des Jahres einen deutlichen Anstieg des Interesses an GenAI-Tools erwarten, müssen Unternehmen schnell handeln, um die Lücke zwischen Einsatz und Sicherheit zu schließen.

Hier sind einige Schritte zum Sicherstellen, dass die Nutzung von GenAI im Unternehmen abgesichert erfolgt:

- Implementierung einer ganzheitlichen Zero Trust-Architektur, um nur zugelassene KI-Anwendungen und User für den Zugriff darauf zu autorisieren.

- Durchführen gründlicher Sicherheitsrisikobewertungen für neue KI-Anwendungen, um Schwachstellen klar zu erkennen und darauf reagieren zu können.

- Einrichtung eines umfassenden Protokollierungssystems zur Nachverfolgung aller KI-Prompts und -Antworten.

- Aktivieren von Zero Trust-gestützten Data Loss Prevention-Maßnahmen (DLP) zum Schutz vor Datenexfiltration für alle KI-Aktivitäten.

Methodik: Im Oktober 2023 beauftragte Zscaler Sapio Research mit der Durchführung einer Umfrage unter 901 IT-Entscheidungsträgern (ITDMs) in zehn Märkten (Australien & Neuseeland, Frankreich, Deutschland, Indien, Italien, Niederlande, Singapur, Spanien, Großbritannien & Irland, USA). Diese IT-Entscheider arbeiten in Unternehmen mit mehr als 500 Mitarbeitenden und in verschiedenen Branchen.